引言

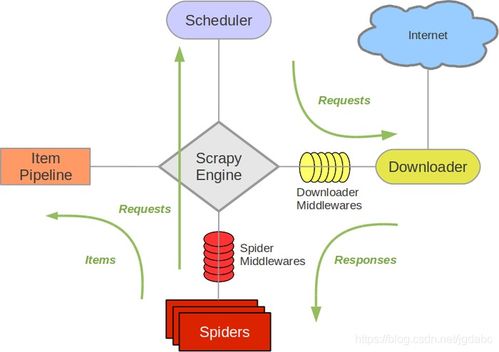

网络爬虫作为数据采集的核心工具,其效能与可靠性直接依赖于对底层网络技术的深入理解。本章旨在系统性地阐述从HTTP/HTTPS协议基础到高级网络编程技术,为构建高效、稳定且可扩展的爬虫系统奠定坚实的网络理论基础。

一、HTTP/HTTPS协议深度剖析

1.1 HTTP请求与响应模型

HTTP协议是爬虫与服务器交互的语言。深入理解其无状态、请求-响应模型至关重要。

- 请求方法:不仅限于GET与POST,需掌握HEAD、PUT、DELETE等方法在特定场景下的应用,例如使用HEAD方法仅获取响应头以节省带宽。

- 请求头(Headers):深入解析关键字段:

User-Agent:模拟不同浏览器环境,规避基础反爬。

Cookie与Session:维持有状态会话,处理登录态。

Referer:标识请求来源,应对反盗链策略。

Accept-*系列:协商内容类型与编码。

- 响应状态码:超越200与404,理解301/302重定向处理、429(请求过多)、503(服务不可用)等状态码的应对策略。

1.2 HTTPS与安全连接

HTTPS在HTTP基础上增加了TLS/SSL加密层。爬虫需处理:

- 证书验证:默认需验证服务器证书,在可控环境下可选择性关闭验证(仅用于测试)。

- SSL/TLS握手:理解握手过程有助于调试连接问题。

- 中间人代理:配合工具(如mitmproxy)进行HTTPS流量抓取与分析,用于逆向工程。

1.3 连接管理与性能优化

- 持久连接(HTTP Keep-Alive):复用TCP连接,显著减少握手开销。

- 连接池技术:管理多个持久连接,实现高效并发。

- 超时与重试机制:合理设置连接、读取超时,并实现带退避策略的智能重试。

二、网络编程核心:Socket与异步IO

2.1 原始Socket编程

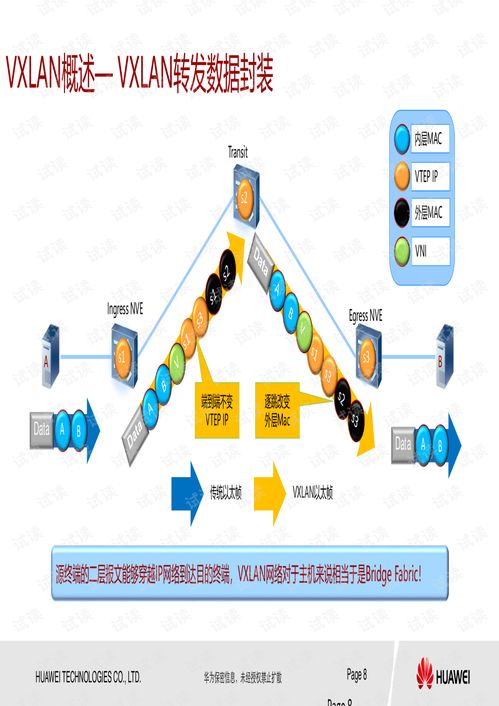

理解TCP/IP模型中的传输层,为高级定制打下基础。

- 手动构造HTTP请求报文并通过Socket发送。

- 解析原始响应报文,包括状态行、头部和正文的分隔处理。

2.2 高并发模型

爬虫性能瓶颈常在于I/O等待,异步编程是解决方案。

- 多线程/多进程:传统方案,需注意GIL(针对Python)限制与进程间通信成本。

- 异步IO(Asyncio/aiohttp):基于事件循环的单线程并发模型,资源利用率高,是现代高性能爬虫的首选。

- 协程(Coroutine)与

async/await语法。

- 使用

aiohttp库实现高并发HTTP请求。

- 信号量控制并发度,避免对目标服务器造成冲击。

三、高级网络技术与反反爬策略

3.1 代理IP池的构建与智能调度

- 代理类型:透明代理、匿名代理、高匿代理的区别与应用场景。

- 代理源:从公开网站抓取、购买优质代理服务、自建代理服务器(如使用Squid)。

- 智能调度系统:

- 健康检查:定期测试代理的连通性、匿名性与速度。

- 优先级队列:根据响应速度、成功率动态调整代理优先级。

- 失败熔断:对连续失败的代理进行临时隔离。

3.2 浏览器引擎与自动化工具

对于依赖JavaScript渲染的现代网站,需模拟真实浏览器。

- Selenium:自动化浏览器操作,支持多种浏览器驱动。

- 无头模式(Headless)节省资源。

- 执行JavaScript,获取动态生成内容。

- Puppeteer/Playwright:更现代的控制方案,提供更丰富的API和更好的性能。

- 指纹伪装:应对通过Canvas、WebGL、字体等生成的浏览器指纹检测。

3.3 流量伪装与行为模拟

- 请求随机化:随机化请求间隔、鼠标移动轨迹(针对自动化工具)、滚动行为。

- 分布式爬虫架构:将爬虫任务分布到多个物理节点(可能在不同地理区域),模拟真实用户分布,同时提升抓取规模与抗封禁能力。

四、实战:构建一个高可用网络模块

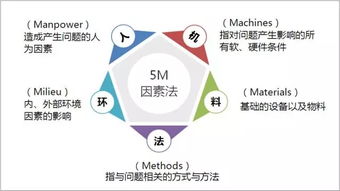

本节将综合运用以上知识,设计一个具备以下特性的爬虫网络模块:

- 异步高并发核心:基于

asyncio与aiohttp。 - 自动会话管理:自动处理Cookie,维护登录状态。

- 智能代理中间件:集成代理池,自动切换失败代理。

- 自适应速率限制:根据服务器响应状态码(如429)动态调整请求频率。

- 完备的日志与监控:记录每个请求的详细指标(响应时间、状态码、使用代理),便于性能分析与问题排查。

###

掌握扎实的网络技术是爬虫工程师从“能用”到“精通”的关键跨越。它不仅关乎能否获取数据,更决定了爬虫系统的效率、稳定性和隐蔽性。本章内容为后续处理数据解析、存储、调度及应对更复杂的反爬机制提供了不可或缺的网络底层支持。在实践中不断调试和优化网络交互细节,是提升爬虫技艺的必经之路。